Kurswechsel · Strategie & Organisation

KI's Produktivitätsfalle

«Ob meine Leute engagiert sind, interessiert mich nicht – ich zahle ihnen ein Gehalt.» Die Aussage klingt pragmatisch. Sie ist es nicht.

Die Illusion der Erfolgsrechnung

Finanzielle Ziele sind messbar. Engagement wirkt weich. Doch die Unterscheidung trügt: Geringes Engagement kostet Organisationen weltweit schätzungsweise 9,6 Billionen Dollar an Produktivitätsverlust – rund 9 % des globalen BIP. Was sich nicht direkt in die Bilanz schreibt, hat trotzdem materielle Konsequenzen.

Engagement als Leistungsarchitektur

Produktivität wird oft mit Effizienz gleichgesetzt. Das greift zu kurz. Leistung zeigt sich auch darin, wie Menschen unter Druck entscheiden, mit Kunden verhandeln oder die Organisation nach aussen vertreten. Ein engagierter Verkäufer folgt nicht nur dem Prozess – er ist präsenter, ausdauernder, wirksamer.

Die Self-Determination Theory benennt Autonomie, Kompetenz und Verbundenheit als psychologische Kerntreiber. Gallup ergänzt wahrgenommenen Sinn als leistungsrelevante Bedingung. KI-Initiativen verändern die Arbeitsstruktur. Die Outputgewinne sind sichtbar – die eigentliche Verschiebung liegt in diesen vier Bedingungen.

Zwei Dimensionen, eine Entscheidung

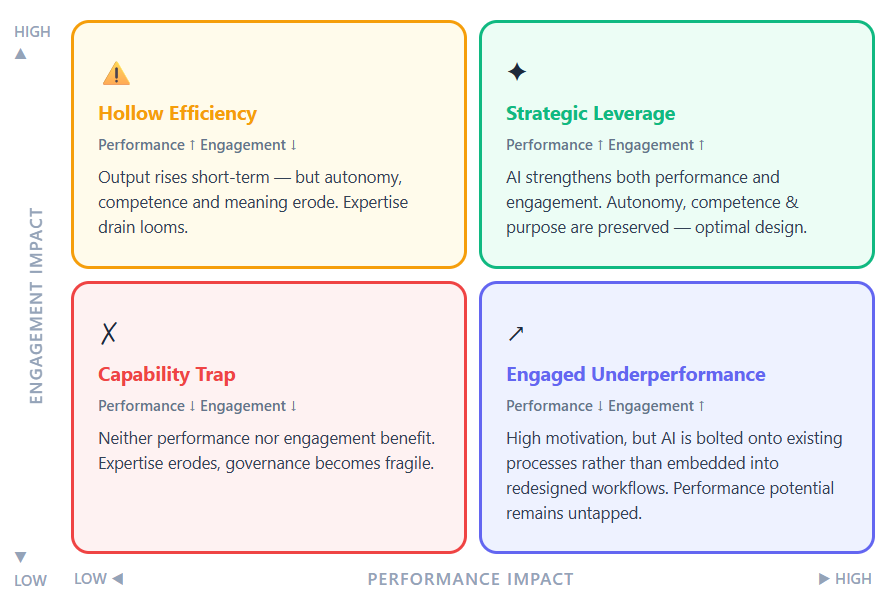

Herkömmliche Human-AI-Matrizen klassifizieren Aufgaben nach Komplexität und komparativem Vorteil: automatisieren, ergänzen, führen, evaluieren. Diese Frameworks klären die Aufgabenverteilung – aber nicht die organisationale Wirkung.

KI-Initiativen bewegen sich in einem zweidimensionalen Raum: Auswirkung auf Leistung und Auswirkung auf Engagement. Beide Dimensionen hängen von Designentscheiden ab – nicht von der Technologie selbst.

- Autonomie verengt sich, wenn Workflows um Systemoutputs kreisen.

- Kompetenz wird anders erlebt, wenn Schöpfen zu Validieren wird.

- Verbundenheit verändert sich, wenn Zusammenarbeit durch Tools vermittelt wird.

- Sinn kann auf Makroebene bestehen – doch das tägliche Erleben von Urheberschaft verblasst.

Expertise als Governance-Frage

Selbst wer Engagement als nachrangig betrachtet, kommt an Expertise nicht vorbei. Forschung zu Automation Bias zeigt, wie rasch Entscheidungsautorität auf Systeme übergeht, sobald deren Verlässlichkeit hoch erscheint. Governance beruht auf Verantwortung unter Unsicherheit – und Verantwortung setzt Expertise voraus.

Werden Einstiegsaufgaben, die traditionell Erfahrungswissen aufbauen, vollständig automatisiert, entsteht kurzfristig kein Defizit. Langfristig aber dünnt die Pipeline aus. Was als operative Optimierung beginnt, kann sich in einen strukturellen Fähigkeitsverlust verwandeln.

Fazit

KI erzeugt keine neue Schwäche – sie macht bestehende Schwächen zum Problem. Wer KI-Initiativen nur entlang der Effizienz bewertet, misst unvollständig.

Führungskräfte sollten daran gemessen werden, wie bewusst sie das Zusammenspiel von Effizienz, Engagement und Expertise gestalten – nicht perfekt, aber aktiv.

Quellen

- Gallup. State of the Global Workplace 2025.

- Ryan, R. M. & Deci, E. L. Self-Determination Theory.

- Khare, S. Software Engineer Warns 'AI Fatigue Is Real'. Business Insider.

- SentiSight. The Human-AI Partnership.

- Nature Portfolio. Examining human reliance on AI in decision making. Scientific Reports.

Dieser Artikel hat eine Frage aufgeworfen?

Sprechen wir darüber.